O usuário do X, @seti_park, reparou numa nova patente intitulada “Conexão não adjacente de chiplets de memória de alta largura de banda, chiplets de E/S e chiplets de computação por meio de pontes lógicas embutidas“.

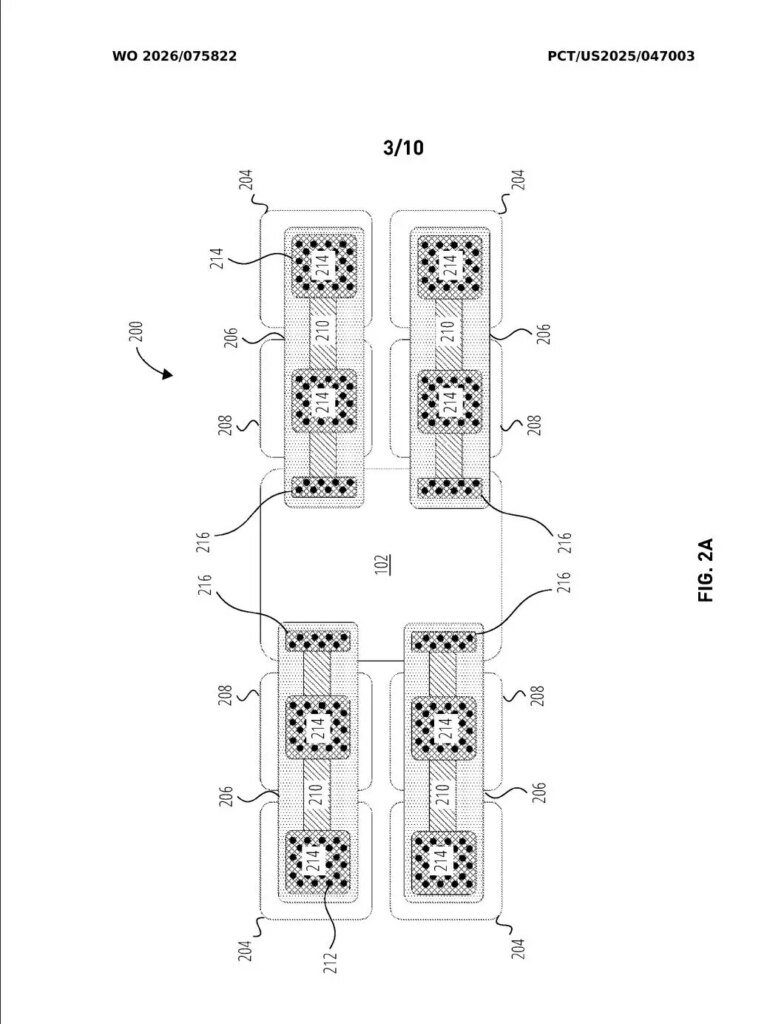

Nela, a OpenAI compartilha planos para uma solução de chip de IA que abrigará vários chiplets de memória HBM e chiplets de computação. E tudo conectado por meio de pontes lógicas embutidas.

A pesquisa propõe a ideia de aproveitar essas pontes lógicas embutidas para interconexões de alta velocidade em distâncias maiores. E isso permite que mais chiplets se conectem para suportar computação de alto desempenho e cargas de trabalho de Inteligência Artificial que exigem grandes quantidades de memória.

Notícias Relacionadas:

- NVIDIA diz que novo ReSTIR Path Tracing é até 3x mais rápido, mas ainda é experimental

- Windows 11 se prepara para trazer agentes de IA à Barra de Tarefas

- Corrida da IA faz Samsung cortar ciclo de chips HBM de 2 anos para apenas 1

Limitações atuais

As soluções de encapsulamento atuais têm certas limitações em relação à integração de HBM. Afinal, esse tipo de memória se comunica com outros chiplets no encapsulamento usando fios metálicos na camada base.

O padrão JEDEC atual exige que a memória HBM seja colocada adjacente ao chiplet de computação e existem limitações físicas com essa abordagem. Especificamente, os fios metálicos precisam ter menos de 6 mm de comprimento a partir do controlador PHY no próprio chiplet principal.

Para superar essa limitação, a patente da OpenAI propõe o uso de pontes lógicas embutidas, que podem estender a distância de 6 mm para 16 mm. Além disso, essa interface D2D (Die-to-Die) está em conformidade com o padrão UCIe (Universal Chiplet Interconnect Express).

Isso traz duas vantagens: além de permitirem distâncias de comunicação maiores, também podem fornecer a funcionalidade de um controlador para a pilha HBM ou a funcionalidade de uma camada física (PHY) de alta velocidade para comunicação entre os chiplets dentro de um encapsulamento.

Futura parceria com a Intel?

Na patente, a OpenAI demonstra um chiplet de computação com 20 pilhas de memória HBM usando as Pontes Lógicas Embutidas. Com as abordagens tradicionais, fica-se limitado a quatro, seis ou oito pilhas. Ou seja, trata-se de um aumento para mais que o dobro.

Essa pesquisa também está alinhada com uma tecnologia em desenvolvimento: a solução EMIB (Embedded Multi-Interconnect Bridge) da Intel. O EMIB é uma solução de encapsulamento avançada que funciona como uma ponte.

Ela foi projetada para lidar com a tecnologia de encapsulamento 2.5D, aproveitando pequenas pontes para expandir as capacidades. A EMIB e sua sucessora, EMIB-T, possuem diversas vantagens: são simples, compactas, expandem os limites de retículo dos interposers atuais e são soluções econômicas.

Isso sugeri que, no futuro, a tecnologia EMIB da Intel pode ser utilizada pela OpenAI para a criação de seus chips de IA personalizados com muitos chiplets e grandes quantidades de memória HBM? Esta patente parece apontar nessa direção.

Fonte: @seti_park e Wipo.