A Samsung apresentou seu chip HBM4E pela primeira vez durante a GPU Technology Conference 2026 (GTC), que vai até o dia 19. Durante o mesmo evento, o CEO da NVIDIA, Jensen Huang, anunciou diversos novos chips e plataformas para processamento de Inteligência Artificial.

Um deles é o chip Groq 3, que será fabricado pela Samsung Foundry. E Isso representa uma grande mudança, já que a Samsung Foundry havia perdido a NVIDIA como cliente.

A Samsung produziu chips para a NVIDIA pela última vez em 2020 (GPUs da série RTX 3000). Posteriormente, o time verde passou a utilizar a TSMC como fabricante exclusiva de suas GPUs para consumidores e outros chips de Inteligência Artificial.

Agora, a NVIDIA está de volta à parceria com a Samsung.

Notícias Relacionadas:

- Samsung pode usar processo de 2nm no die de suas memórias HBM4E

- NVIDIA lança a arquitetura de armazenamento BlueField-4 STX

- NVIDIA anuncia projeto “Open Physical AI Data Factory” para acelerar desenvolvimento de robótica e veículos autônomos

Focado em IA Agêntica

O Groq 3 é projetado pela Groq, uma empresa de semicondutores fabless com sede nos EUA, especializada em chips de inferência de IA. O novo chip de unidade de processamento de linguagem (LPU) será fabricado pela Samsung Foundry usando seu processo de 4 nm (SF4X) e tem previsão de lançamento para o terceiro trimestre.

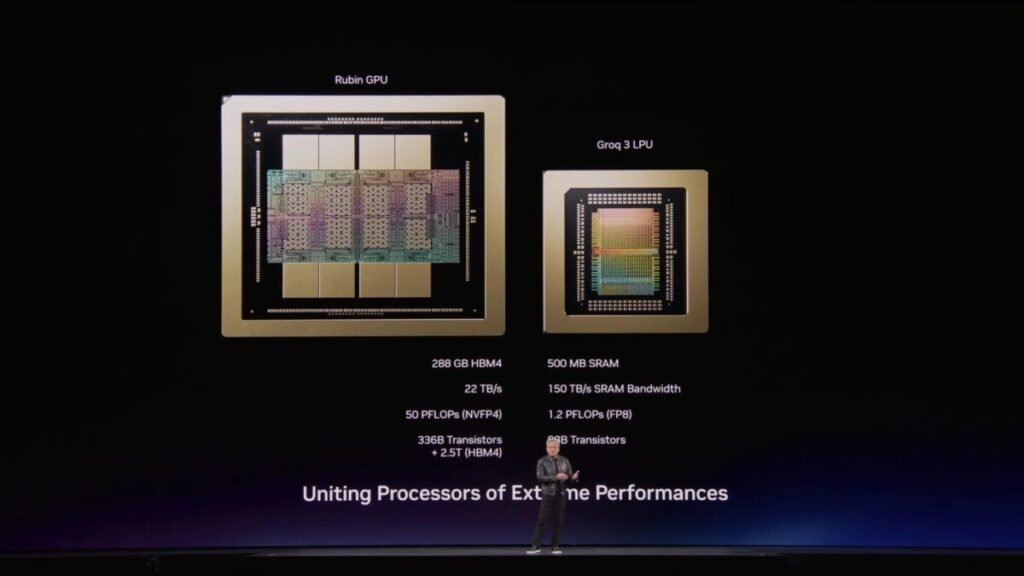

Ele conta com 500 MB de SRAM e 98 bilhões de transistores, oferecendo até 150 TB/s de largura de banda. Isso é significativamente superior aos 22 TB/s oferecidos por uma quantidade equivalente de memória HBM4.

O chip oferece quase sete vezes mais largura de banda do que a plataforma Rubin da NVIDIA com HBM. Ele é especialmente otimizado para tarefas sequenciais de baixa latência, como a fase de decodificação da inferência de modelos de linguagem de grande porte (LLM).

Também foi projetado para IA agêntica, uma área emergente da IA focada em sistemas capazes de executar tarefas complexas e com várias etapas de forma autônoma.

Enquanto o Groq 3 é especializado em chats em tempo real com IA e tarefas de IA agêntica, os chips Rubin da NVIDIA são de uso geral e mais adequados para análise de dados e treinamento de modelos de IA. O Groq 3 poderá ser usado com o sistema Vera Rubin Ultra da NVIDIA quando este for lançado ainda este ano.

Ausência do Rubin

Também chamou a atenção a ausência de qualquer menção ao acelerador de fase de contexto Rubin CPX, que a empresa promoveu no ano passado como parte importante da plataforma Vera Rubin. O Rubin CPX também não foi mencionado nos slides apresentados durante a palestra.

Em contrapartida, os slides mencionam os processadores Groq 3 LPU e os racks LPX da Nvidia, o que pode indicar que esses processadores estão substituindo o CPX no roadmap da Nvidia.

A GPU Rubin CPX da NVIDIA foi concebida para integrar as plataformas Vera Rubin e Vera Rubin Ultra. Elas foram projetadas para acelerar a fase inicial de contexto, que exige alto poder computacional, de uma consulta, processando a entrada para gerar o primeiro token de saída.

A principal vantagem do acelerador de fase contextual era sua utilização de memória GDDR7, que não oferece largura de banda extrema como HBM3E ou HBM4, mas consome muito menos energia. Segundo a NVIDIA, isso melhoraria significativamente a competitividade da plataforma Rubin para cargas de trabalho de inferência.

Por hora, não está claro, mas há sinais de que a NVIDIA pode redirecionar seus esforços para os aceleradores de inferência de baixa latência Groq 3 LPU. Dado o recente investimento da NVIDIA na aquisição da tecnologia de chips e talentos da startup Groq por US$ 20 bilhões (R$ 103,98 bilhões), a mudança faria sentido.

Fonte: Sam Mobile.