A NVIDIA começou a entregar amostras de sua plataforma Vera Rubin para data centers de Inteligência Artificla de última geração a clientes selecionados. O anuncio foi feito pela empresa em sua teleconferência de resultados durante o dia de ontem.

Assim que os parceiros da empresa qualificarem e validarem a nova plataforma, poderão iniciar os preparativos para sua implementação. A previsão é para o segundo semestre de 2026 ou início de 2027.

Isso significa quase certamente que as especificações de desempenho e consumo de energia dos componentes já foram definidas. Porém, ainda não se sabe se a empresa acabou atualizando o desempenho de suas GPUs para consolidar sua liderança.

Rumores sugerem que a Nvidia pretende enviar aos seus parceiros bandejas de computação VR200 de nível 10 (L10) totalmente montadas, com CPUs Vera e GPUs Rubin, sistemas de refrigeração e interfaces pré-instalados. Na prática, isso deve deixar pouca liberdade de projeto e integração para seus ODMs.

Notícias Relacionadas:

- NVIDIA Feynman pode aparecer na GTC 2026: o primeiro chip do mundo em 1,6nm

- Como rodar o OpenClaw gratuitamente em GPUs GeForce RTX e NVIDIA RTX e no DGX Spark

- NVIDIA abre vaga para profissionais que otimizem performance do Vulkan e Proton no Linux

Características

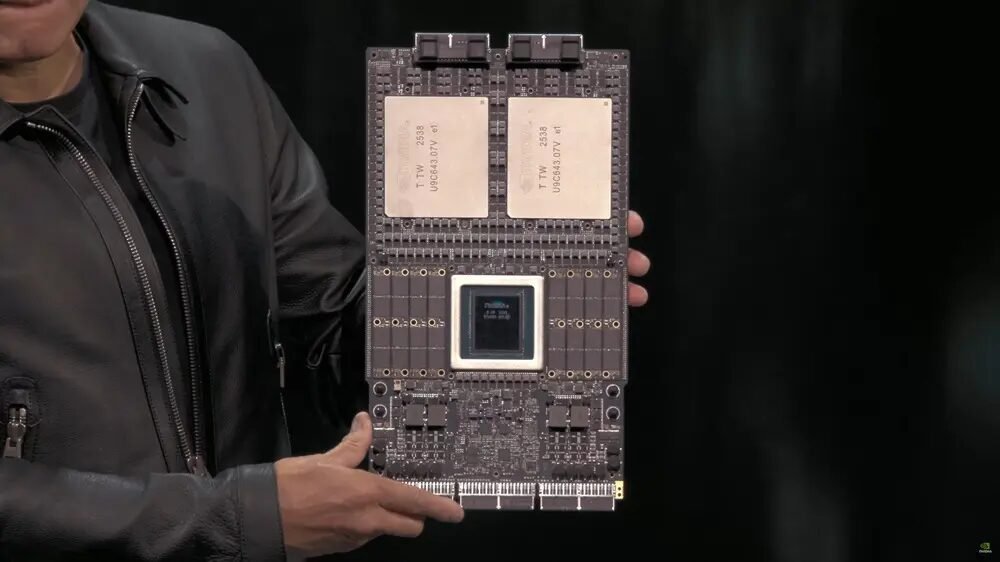

A plataforma Vera Rubin da NVIDIA é a arquitetura de próxima geração da empresa para data centers de IA, que inclui uma CPU Vera de 88 núcleos, GPU Rubin com 288 GB de memória HBM4, GPU Rubin CPX com 128 GB de GDDR7.

Ela também vem com ASIC de switch NVLink 6.0 para conectividade escalável em racks, DPU BlueField-4 com SSD integrado para armazenamento de cache de chave-valor, Ethernet Spectrum-6 Photonics e NICs InfiniBand Quantum-CX9 Photonics de 1,6 Tb/s.

As configurações ainda incluem Ethernet Spectrum-X Photonics e switches InfiniBand Quantum-CX9 Photonics para conectividade escalável horizontalmente.

Consequentemente, para se prepararem para a chegada da plataforma Vera Rubin, os parceiros da empresa precisam adaptar seus softwares e hardwares. Assim, diferentes parceiros receberão diferentes partes da plataforma, enquanto alguns receberão racks NVL72 VR200 com todos os componentes mencionados.

Além disso, amostras de silício real também serão enviadas a parceiros de hardware, como Foxconn, Quanta, Supermicro, Wistron e outros fabricantes renomados de servidores de IA.

| Especificação | NVIDIA Vera Rubin NVL72 | NVIDIA Vera Rubin Superchip | NVIDIA Rubin GPU |

|---|---|---|---|

| Configuração | 72 GPUs NVIDIA Rubin | 36 CPUs NVIDIA Vera | 2 GPUs NVIDIA Rubin | 1 CPU NVIDIA Vera | 1 GPU NVIDIA Rubin |

| Inferência NVFP4 | 3.600 PFLOPS | 100 PFLOPS | 50 PFLOPS |

| Treinamento NVFP4 | 2.520 PFLOPS | 70 PFLOPS | 35 PFLOPS |

| Treinamento FP8/FP6 | 1.260 PFLOPS | 35 PFLOPS | 17,5 PFLOPS |

| INT8 | 18 POPS | 0,5 POPS | 0,25 POPS |

| FP16/BF16 | 288 PFLOPS | 8 PFLOPS | 4 PFLOPS |

| TF32 | 144 PFLOPS | 4 PFLOPS | 2 PFLOPS |

| FP32 | 9.360 TFLOPS | 260 TFLOPS | 130 TFLOPS |

| FP64 | 2.400 TFLOPS | 67 TFLOPS | 33 TFLOPS |

| FP32 SGEMM | 28.800 TFLOPS | 800 TFLOPS | 400 TFLOPS |

| FP64 DGEMM | 14.400 TFLOPS | 400 TFLOPS | 200 TFLOPS |

| Memória GPU | Largura de Banda | 20,7 TB HBM4 | 1.580 TB/s | 576 GB HBM4 | 44 TB/s | 288 GB HBM4 | 22 TB/s |

| Largura de Banda NVLink | 260 TB/s | 72 TB/s | 3,6 TB/s |

| Largura de Banda NVLink-C2C | 65 TB/s | 1,8 TB/s | — |

| Núcleos de CPU | 3.168 núcleos NVIDIA Olympus personalizados (compatíveis com Arm) | 88 núcleos NVIDIA Olympus (compatíveis com Arm) | — |

| Memória da CPU | 54 TB LPDDR5X | 1,5 TB LPDDR5X | — |

| Total de Chips NVIDIA + HBM4 | 1.296 | 30 | 12 |

Fonte: NVIDIA.