A execução de agentes de inteligência artificial diretamente no hardware do usuário traz vantagens de privacidade e custo. Se você busca entender como rodar o OpenClaw em suas placas RTX ou em sistemas com NVIDIA DGX, o processo envolve o uso de ferramentas como WSL e backends otimizados.

O OpenClaw, anteriormente conhecido como Clawdbot, opera como um assistente local capaz de memorizar conversas e utilizar o contexto de arquivos pessoais para automatizar tarefas na máquina.

É por isso que agente foi adquirido pela OpenAI e é considerado como um marco dentro da breve história da IA generativa, pois se destaca pela capacidade de adaptação e expansão através de novas habilidades.

Além disso, agora, ao contrário de soluções em nuvem, que podem gerar custos recorrentes e exigem o envio de dados para servidores externos, a execução local utiliza os Tensor Cores das placas GeForce RTX para acelerar operações de IA.

Veja como fazer para configurar essa ferramenta no Windows:

Riscos e precauções de segurança

Antes de iniciar a instalação, é necessário compreender as implicações de manter um agente de IA com acesso aos seus dados. Os dois principais vetores de risco envolvem o vazamento de informações pessoais e a exposição a códigos maliciosos através de ferramentas conectadas ao bot.

Para mitigar estes problemas, recomenda-se as seguintes práticas:

- Ambiente isolado: use uma máquina virtual ou um computador secundário sem dados sensíveis críticos.

- Contas dedicadas: evite conectar suas contas principais; crie credenciais específicas para o agente.

- Acesso restrito: certifique-se de que a interface web do OpenClaw não esteja acessível via internet aberta.

Configuração do ambiente no Windows

O método mais estável para a instalação utiliza o Subsistema Windows para Linux (WSL). Instalações diretas via PowerShell podem apresentar instabilidade.

1. Instalação do WSL

Caso ainda não possua o recurso ativo, abra o PowerShell como administrador e execute:

wsl --installApós a conclusão, reinicie o sistema se solicitado e verifique a instalação com o comando `wsl –version`. Para acessar o ambiente Linux, digite `wsl` no terminal.

2. Instalando o OpenClaw

Dentro do terminal WSL, inicie o script de instalação automática:

curl -fsSL https://openclaw.ai/install.sh | bashDurante o processo, siga as etapas de configuração:

- Selecione Sim para os avisos de segurança.

- Escolha a opção Início Rápido (Quick Start).

- Na seleção de provedor de modelo, opte por Ignorar por enquanto, pois a configuração será feita para execução local.

- Em “Habilidades” (Skills) e instalação do Homebrew, selecione Não para agilizar o processo inicial.

- Anote o URL e o token de acesso exibidos no final do terminal; eles são necessários para acessar o painel de controle.

Execução de LLMs Locais

Para processar as informações sem internet, é preciso configurar um backend de IA. O desempenho dependerá da quantidade de VRAM disponível na sua placa de vídeo.

Escolha do Backend

Existem duas opções principais recomendadas para usuários de hardware NVIDIA:

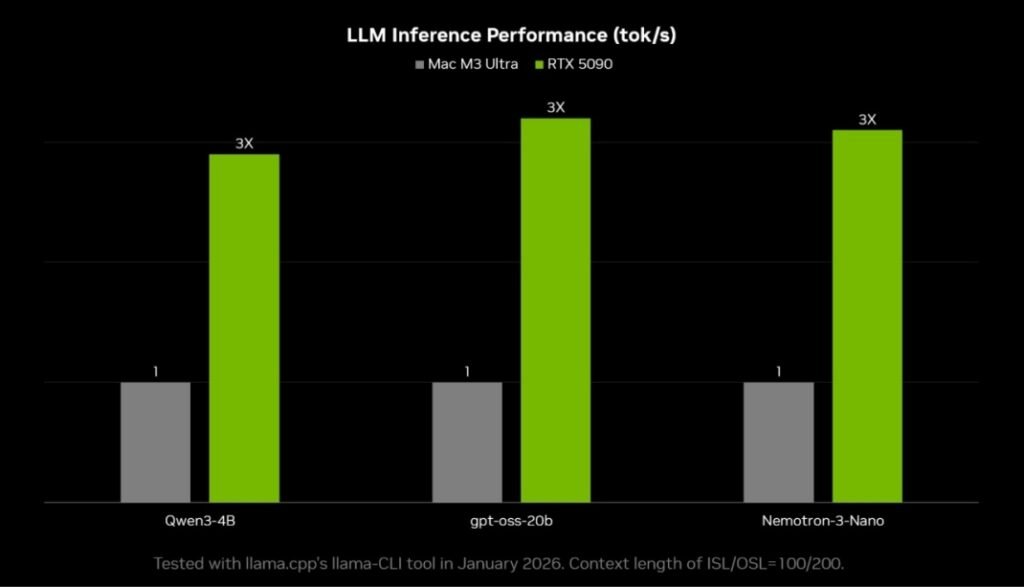

- LM Studio: recomendado para performance bruta, utilizando Llama.cpp.

- Ollama: focado em facilidade de implantação e ferramentas para desenvolvedores.

Para instalar, execute o comando correspondente ao backend escolhido no terminal WSL:

LM Studio: curl -fsSL https://lmstudio.ai/install.sh | bash

Ollama: curl -fsSL https://ollama.com/install.sh | sh

Seleção de Modelos por VRAM

A escolha do modelo deve respeitar a memória de vídeo para evitar travamentos. Sugestões baseadas na capacidade da GPU:

- 8GB a 12GB: qwen3-4B-Thinking-2507

- 16GB: gpt-oss-20b

- 24GB a 48GB: Nemotron-3-Nano-30B-A3B

Após baixar o modelo (ex: `ollama pull gpt-oss:20b`), é necessário editar o arquivo `openclaw.json` localizado na pasta `.openclaw` para apontar para o servidor local (localhost), conforme detalhado na documentação oficial da ferramenta.

Com o gateway configurado e o modelo carregado, basta acessar o link do painel salvo anteriormente. O processamento local entrega maior privacidade, mas exige monitoramento constante do consumo de recursos do sistema.

Fonte(s): NVIDIA

Leia também: