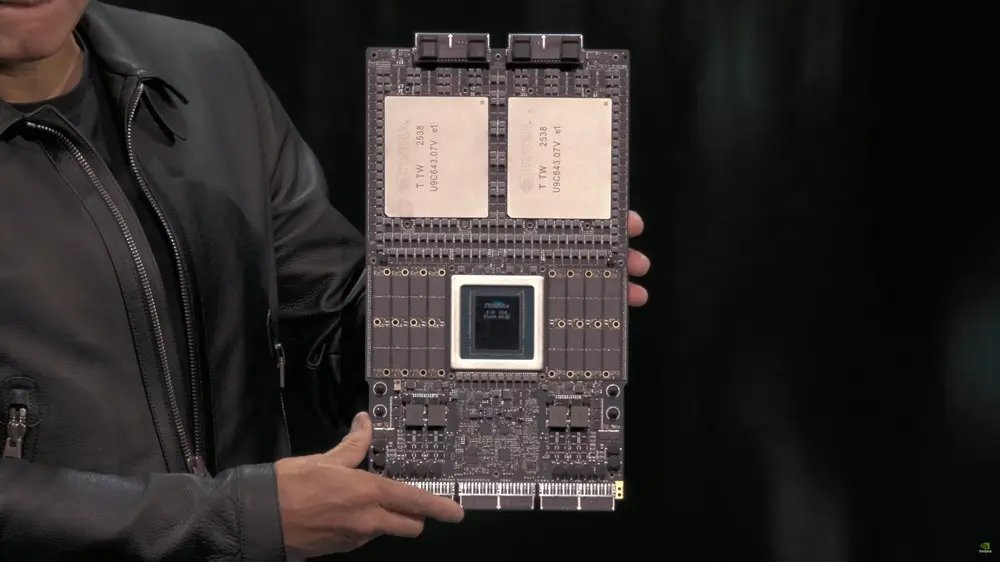

A NVIDIA aproveitou a edição de 2025 de sua GTC (GPU Technology Conference) para mostrar pela primeira vez o chamado Superchip Vera Rubin. Trata-se de um sistema para processamento computacional, especialmente voltado para IA, equipado com CPU Vera e duas enormes GPUs Rubin.

O modelo mostrado traz oito espaço para módulos HBM4 e dois dies de tamanho máximo da GPU. A NVIDIA ressalta que as unidades Rubin devem entrar em produção em massa entre o Q3 e o Q4 de 2026, então pretende entregar os primeiros sistemas Vera Rubin no segundo semestre do ano que vem.

NVIDIA Vera Rubin NVL144 chega primeiro

O Superchip mostrado é um exemplo em que o primeiro produto da linha vai se basear, o sistema NVL144. É esse produto que está previsto para o segundo semestre de 2026, trazendo uma CPU Vera com 88 núcleos ARM customizados e 176 threads, prometendo até 1,8TB/s pela interconexão NVLink-C2C.

As duas GPUs Rubin prometem um total de 50PFLOPs de performance, auxiliadas por 288GB de HBM4.

Como não poderia deixar de falar de IA, a NVIDIA afirma que o Vera Rubin NVL144 vai entregar até 3,6exaFLOPS de inferência em FP4, indo até 1,2exaFLOPS para treinamento em FP8. Os números são, aproximadamente, 3,3 vezes maiores do que o oferecido pelo GB300 NVL72.

GPUs RTX em oferta:

- Inno3D RTX 5080 X3 por R$ 8.000

- ASUS RTX 5060 Ti Dual OC por R$ 2.850

- ASUS RTX 5050 Prime OC por R$ 2.020

Rubin Ultra NVL576 traz 4 GPUs

Apesar de mostrar o Superchip em mãos apenas para o NVL144, a NVIDIA também apresentou um slide para o que prepara para 2027, também no segundo semestre. O chamado Rubin Ultra NVL576 mantém a mesma CPU Vera do sistema mais próximo, mas dobra o número de GPUs Rubin para quatro.

Leia mais:

- NVIDIA pode ser a primeira cliente para o processo A16 da TSMC nas GPUs Feynman

- NVIDIA e TSMC celebram primeiro wafer Blackwell feito nos EUA – com um “porém”

- NVIDIA revela plataforma Kyber com até 576 GPUs Rubin Ultra para impulsionar a IA até 2027

O resultado são 100PFLOPs de performance, com 1TB de HBM4. Os números em inferência FP4 vão para 15exaFLOPS, com o treinamento em FP8 alcançando 5exaFLOPs. São 14 vezes mais desempenho do que o oferecido pelo GB300 NVL72.

Por fim, a empresa enfatiza que pretende oferecer performance múltiplas vezes melhor em novos produtos ano a ano.

Via: WCCFTech